揭秘人工智能 数据隐私、安全挑战与硬件销售新格局

在人工智能(AI)技术迅猛发展的今天,其应用已渗透到我们生活的方方面面,从智能助手到自动驾驶,从医疗诊断到金融风控。伴随技术红利而来的,是日益严峻的数据隐私与安全问题。与此作为AI技术落地的物理基础,人工智能硬件销售市场也正在经历深刻的变革。本文将深入探讨这三个相互关联的核心议题。

一、数据隐私:AI发展的双刃剑

人工智能的“智能”很大程度上源于对海量数据的学习与分析。无论是监督学习还是无监督学习,高质量的数据都是模型训练不可或缺的燃料。这就引发了一个根本性矛盾:AI对数据的渴求与个人数据隐私保护之间的冲突。

- 数据收集的边界:企业在开发AI应用时,往往需要收集用户的行为数据、生物特征信息(如人脸、指纹)等敏感信息。问题在于,收集的范围是否明确、目的是否正当、用户是否知情并同意?过度收集和滥用数据的事件时有发生,侵蚀着用户信任。

- “匿名化”的脆弱性:许多公司声称使用“匿名化”数据,但研究表明,通过交叉比对多个数据集,重新识别个人身份的可能性依然存在,使得匿名化措施形同虚设。

- 算法偏见与歧视:如果训练数据本身包含社会固有偏见(如种族、性别歧视),AI模型会学习并放大这些偏见,导致不公平的结果,这本质上是数据隐私滥用的延伸,对特定群体造成潜在伤害。

保护数据隐私需要法规、技术与伦理的三重护航。欧盟的《通用数据保护条例》(GDPR)、中国的《个人信息保护法》等为数据处理划定了红线。技术层面,联邦学习、差分隐私、同态加密等隐私计算技术正在兴起,力求实现“数据可用不可见”。

二、安全挑战:从算法到系统的全方位威胁

AI系统的安全不再仅仅是传统的网络安全问题,更延伸至算法和模型本身。

- 对抗性攻击:这是针对AI模型特有的威胁。攻击者通过向输入数据(如图像、音频)添加人眼难以察觉的细微扰动,就能导致模型做出完全错误的判断。例如,让自动驾驶汽车将“停车”标志误认为“限速”标志,后果不堪设想。

- 模型窃取与逆向工程:商业AI模型是企业的核心资产。攻击者可能通过反复查询API,来“窃取”或复制模型的功能,侵犯知识产权。

- 数据投毒:在模型训练阶段,如果恶意污染训练数据,就能“教坏”AI,使其在后续决策中产生预期外的、甚至有害的行为。

- 硬件后门与供应链安全:AI硬件(如GPU、专用芯片)的供应链全球化,使得硬件中植入恶意后门的风险增加,可能危及整个系统的安全根基。

因此,构建安全的AI系统需要贯穿其全生命周期,涵盖安全的数据供应链、鲁棒的模型训练、持续的威胁监测与应急响应。

三、人工智能硬件销售:驱动技术落地的引擎

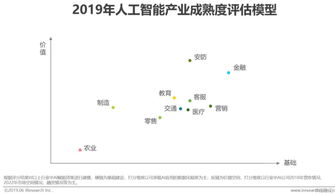

AI的爆炸式增长催生了对专用硬件的巨大需求,推动了从云端到边缘的硬件销售市场格局重塑。

- 市场驱动因素:

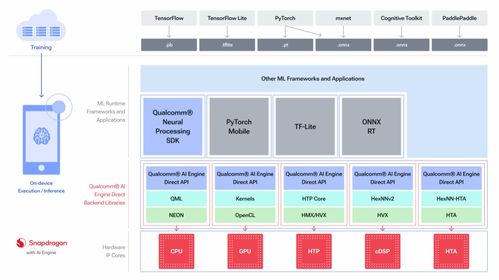

- 算力需求爆炸:复杂的深度学习模型需要巨大的计算资源,直接拉动了高性能GPU(英伟达等)、AI专用芯片(如谷歌TPU、华为昇腾、寒武纪等)的销售。

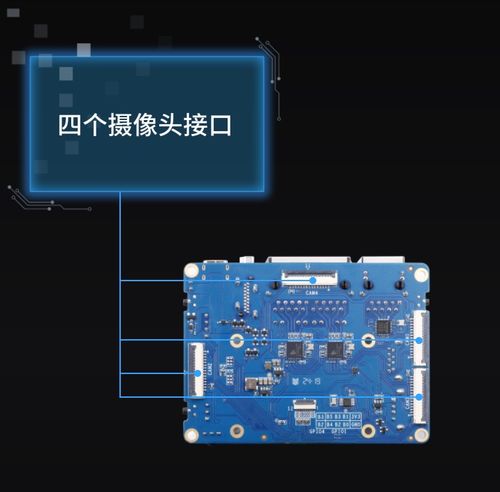

- 边缘计算兴起:为了降低延迟、保护隐私,越来越多的AI推理任务需要在终端设备(如手机、摄像头、物联网设备)上完成,这推动了低功耗、高性能的边缘AI芯片市场。

- 行业解决方案定制化:不同行业(安防、医疗、工业质检)对AI硬件的需求各异,促使硬件供应商与解决方案提供商深度融合,提供“芯片+算法+服务”的一体化销售模式。

- 销售模式变革:

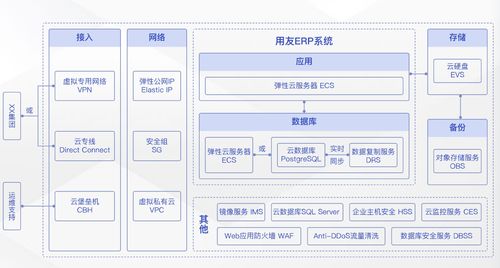

- 从卖硬件到卖服务:许多厂商不再单纯销售芯片或服务器,而是提供基于硬件的云服务(AI Training as a Service, AI Inference as a Service),降低了用户的使用门槛。

- 生态构建成为关键:硬件厂商积极构建软件栈(如CUDA生态)、开发者社区和行业伙伴联盟,通过繁荣生态来锁定用户,提升硬件附加值。

- 地缘政治影响:全球供应链紧张和科技竞争,使得AI硬件销售带有战略色彩,自主可控的国产AI硬件产业链迎来发展机遇,市场呈现多元化竞争态势。

人工智能的旅程充满希望也布满荆棘。数据隐私与安全是保障其健康、可信、可持续发展的基石,需要全球协作、持续创新与严格治理。而人工智能硬件销售的蓬勃发展,正是将智能算力转化为现实生产力的关键桥梁。只有将稳健的隐私保护、坚固的安全防线与强大的硬件基础设施有机结合,才能驾驭人工智能的巨浪,真正造福人类社会。在享受AI便利的对其潜在风险的清醒认识与未雨绸缪,是我们这个时代必须肩负的责任。

如若转载,请注明出处:http://www.mittgz.com/product/25.html

更新时间:2026-04-08 15:09:28